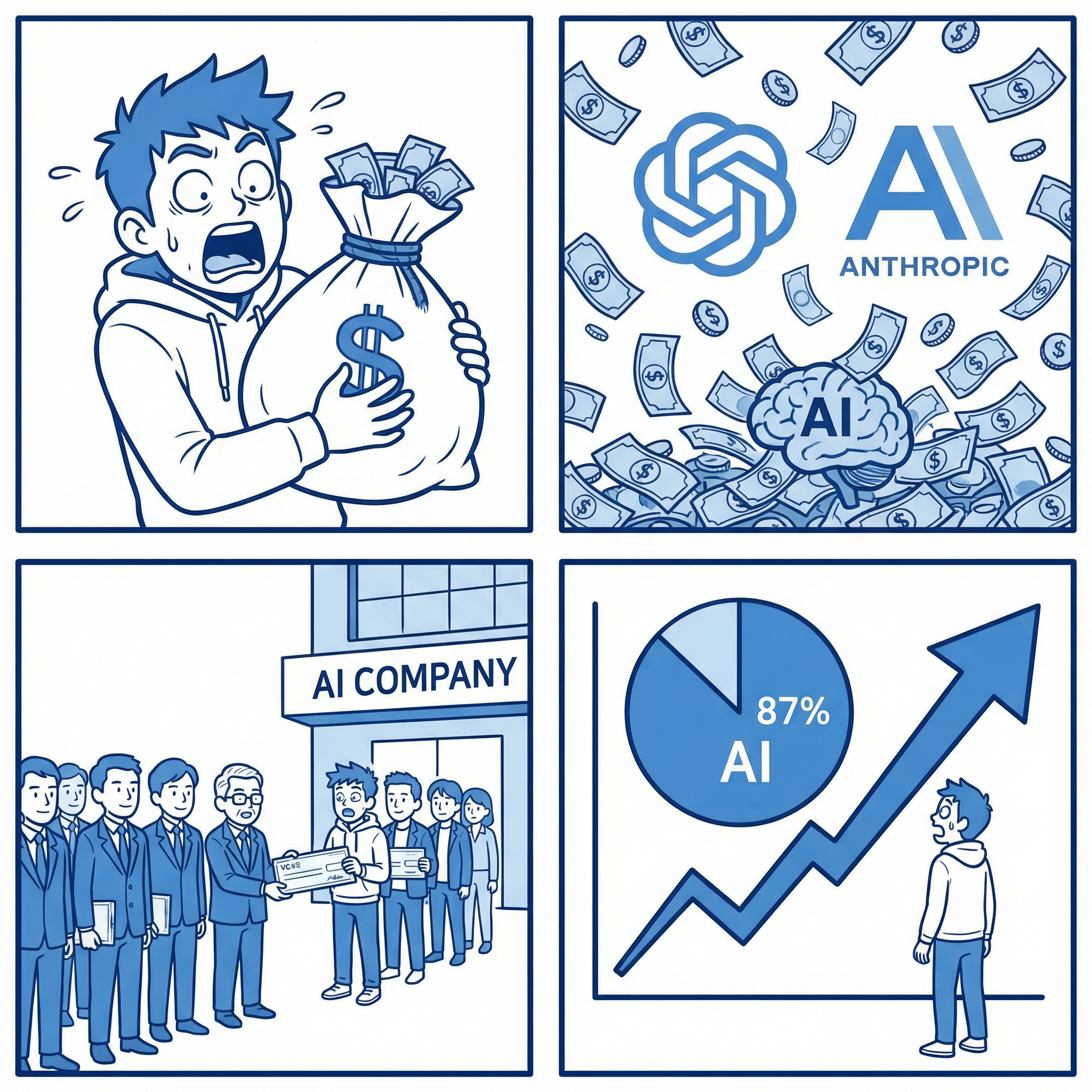

북미 Q1 2026 VC 투자 2,526억 달러로 역대 최고 경신… AI가 전체의 87% 독식

2026년 1분기 북미 벤처캐피털 투자가 전례 없는 기록을 세웠다. 크런치베이스 데이터에 따르면 미국과 캐나다 스타트업이 시드부터 성장 단계까지 유치한 총 투자액은 2,526억 달러(약 374조 원)로, 역대 분기 최고치를 경신했다. 이 수치는 직전 분기 대비 3배 이상이며, 기존 분기 최고 기록이었던 2021년 3분기의 957억 달러를 압도한다. 크런치베이스의 표현을 빌리면 '경신'이 아니라 '분쇄(smashed)'에 가깝다. 규모를 가늠하는 기준점 하나 OpenAI 단 한 건의 투자 라운드가 기존 역대 분기 최고 기록 전체보다 컸다. OpenAI는 2월 아마존, 엔비디아, 소프트뱅크 주도로 1,100억 달러(약 163조 원)를 유치하고, 3월에 120억 달러를 추가로 조달했다. 나머지 상위 4건의 투자 합산도 기존 분기 최고치에 맞먹었다. 앤트로픽 시리즈 G 300억 달러, xAI 시리즈 E 200억 달러, Waymo 시리즈 D 160억 달러가 상위권을 채웠다. AI가 전체 투자의 87%를 차지 AI 관련 카테고리로 흘러들어간 투자액은 2,210억 달러(약 327조 원)로 전체의 87%에 달한다. 직전 분기 AI 투자 총액 대비 6배 수준이다. 후기 및 성장 단계 투자는 전체의 88%인 2,224억 달러를 기록했다. 주목할 점은 투자 건수가 아니라 건당 규모가 폭발적으로 커졌다는 것이다. 후기·성장 단계 라운드 건수는 오히려 직전 분기 대비 소폭 감소했다. 더 큰 베팅이 더 적은 수에 집중되는 양상이다. 초기 단계도 3년 만에 최고 기록 경신은 대형 딜에만 국한되지 않았다. 시리즈 A·B 수준의 초기 단계 투자도 251억 달러로 전년 대비 56% 증가하며 3년 이상 만에 가장 높은 분기 수치를 기록했다. 시드 단계 역시 10억 달러를 넘어 3년 만의 최고치를 보였다. 전 단계에 걸쳐 동시에 기록이 나온 것은 이례적이다. 패러다임 전환인가, 버블인가 크런치베이스는 이번 분기를 단순한 기록 경신이 아니라 '패러다임 전환(paradigm shift)'의 신호로 해석한다. AI 인프라와 에이전틱 AI 응용 분야에 대형 LP들의 자본이 집중되면서, 2026년 AI 투자 사이클이 단순한 하이프 국면을 벗어나 구조적 재편으로 굳어지고 있다는 평가다.

- 팀제이커브팀